AI企業が、アメリカの国防総省(ペンタゴン)に逆らった。

「自律型兵器には使わせない」「国民の大量監視には使わせない」。その2つの条件を譲らなかったAIスタートアップが、わずか数日で「国家安全保障上のリスク」に指定され、米国政府全体から締め出された。

2026年2月の最終週に起きたことは、AI業界の歴史に残る事件だ。

登場人物が多く、話が入り組んでいる。時系列で整理しながら、「なぜこうなったのか」を一つずつ解きほぐしていく。

まず、登場人物を整理する

この話には主に4人の重要人物と、2つの企業が出てくる。先に押さえておく。

- ダリオ・アモデイ(Dario Amodei): Anthropic(アンソロピック)のCEO。もともとOpenAIの研究副社長だったが、「OpenAIはAIの安全性を軽視している」と考え、2021年に妹のダニエラとともに退社してAnthropicを創業した。「AIの安全な開発」を会社の最上位の目標に掲げている

- ダニエラ・アモデイ(Daniela Amodei): Anthropicの社長。兄ダリオとともにOpenAIを離れて共同創業した

- ピート・ヘグセス(Pete Hegseth): トランプ政権の国防長官。元FOXニュースのキャスターで、軍内部の「ウォーク(woke=進歩的・リベラル的)な文化」を一掃すると公言している人物

- サム・アルトマン(Sam Altman): OpenAIのCEO。Anthropicとは競合関係にある

そして2つの企業。

- Anthropic(アンソロピック): AIモデル「Claude(クロード)」を開発するスタートアップ。「責任あるスケーリング(Responsible Scaling)」を掲げ、AIの能力を上げるときは安全性テストも同時に厳しくするという方針で知られる

- OpenAI(オープンエーアイ): 「ChatGPT」で知られるAI企業。もともとは非営利だったが営利化が進んでおり、Anthropicとはライバル関係にある

【2025年7月】すべての始まり。2億ドルの契約

2025年7月、Anthropicは米国防総省と大型契約を結んだ。金額は最大2億ドル(約300億円)。2年間のプロトタイプ契約で、国防総省のCDAO(最高デジタル・AI責任者室)が管轄する。

(参考:Anthropic and the Department of Defense to Advance Responsible AI | Anthropic)

内容は、Claudeを軍の機密ネットワークに導入すること。情報分析や意思決定の補助にAIを使うという、いわば「軍のDX」だ。

なぜAnthropicが軍と契約したのか。これには背景がある。

Anthropicはもともと「AIの軍事利用」に慎重な姿勢だった。でも2024年頃から方針を転換している。ダリオ・アモデイはその理由をこう説明している。「米国がAI技術でリードし続けることは、民主主義の側がAIを適切に管理するために重要だ」。つまり、米軍にAIを使わせないことが安全なのではなく、米軍が安全な形でAIを使えるようにすることが重要だ、という考え方だ。

(参考:Dario Amodei’s Patriotic Pivot | WebProNews)

ただし、Anthropicには絶対に譲れない2つの条件があった。

- 完全自律型兵器には使わせない: 人間が最終判断に関与しない状態で、AIだけで攻撃目標を選定・実行するような使い方は認めない

- 米国市民への大量監視には使わせない: AIを使ってアメリカ国民の行動を大規模に監視・追跡するような用途は認めない

この2つの「レッドライン(絶対に越えない一線)」は、契約の当初から存在していた。

【2026年2月中旬】交渉が暗礁に乗り上げる

契約から約7ヶ月。更新交渉の時期が近づいた。ここで問題が表面化する。

(参考:Anthropic-Pentagon Feud Over AI Technology Is a Bad Sign | Foreign Policy)

国防総省側の要求はシンプルだった。「Claudeをすべての合法的な軍事目的に使わせろ」。つまり、法律に違反しない範囲なら、使い方は軍が決める。企業が口出しするなということだ。

なぜ国防総省はこう主張したのか。

ヘグセス国防長官の立場からすると、民間企業が軍の運用に制限をかけること自体が問題だった。「あなたは軍を信頼すべきだ。軍は正しいことをする」。これは国防総省の高官がCBSニュースの取材で実際に発言した言葉だ。軍の判断に民間企業が条件をつけるのは、国家安全保障を損なうという考え方だ。

(参考:Pentagon official lashes out at Anthropic | CBS News)

一方、Anthropic側にも譲れない理由があった。

ダリオ・アモデイはCBSニュースの独占インタビューでこう語っている。「自律型兵器と大量監視は、たとえ現時点で合法であっても、濫用されるリスクが極めて高い。私たちはこの2つについて良心に従って同意することができない」。

(参考:Anthropic CEO says he’s sticking to AI red lines | CBS News)

特に「大量監視」の部分は具体的なリスクがあった。AIを使えば、SNSの投稿、位置情報、通信記録を大規模に分析して、特定の思想や活動をしている人々を自動的にリストアップすることが技術的に可能になる。アモデイはこれを「民主主義に対する根本的な脅威」と位置づけていた。

【2月24日】最後通牒

2月24日、ヘグセス国防長官がダリオ・アモデイと直接会談した。

(参考:Exclusive: Hegseth gives Anthropic until Friday to back down | Axios)

会談の場でヘグセスが突きつけたのは、明確な最後通牒(アルティメイタム)だった。「2月27日金曜日までにAIの安全措置を解除せよ。さもなければ契約を失い、さらなる措置を取る」。

「さらなる措置」として国防総省側がちらつかせたのが2つあった。

- サプライチェーンリスク指定: 企業を「国家安全保障上のリスク」に指定する制度。指定されると、軍の請負業者はその企業との取引ができなくなる。たとえば、軍向けにAIインフラを提供しているPalantir(パランティア)、クラウド基盤のAmazon Web ServicesやGoogle Cloud、防衛コンサルのBooz Allen Hamilton(ブーズ・アレン・ハミルトン)、半導体のNvidiaなど、Anthropicと取引のある大手軍事関連企業がすべて影響を受ける。通常は中国やロシアなど敵対国の企業に対して使われる措置で、米国企業に適用された前例はない

- 国防生産法(Defense Production Act)の発動: 1950年代の朝鮮戦争時代に作られた法律で、国家の安全保障のために民間企業に特定の製品やサービスの提供を強制できる。戦時中に工場に兵器の生産を命じるような場面を想定した法律だ

ヘグセスがAnthropicの安全措置を「ウォークAI(woke AI)」と呼んだことも注目された。「ウォーク」とは、もともとは社会的な不公正に敏感であることを意味する言葉だが、トランプ政権の文脈では「行き過ぎたリベラル思想」を指す否定的なレッテルとして使われている。つまりヘグセスは、AIの安全措置を「政治的に偏った制限」だと位置づけたのだ。

(参考:Hegseth threatens to blacklist Anthropic over ‘woke AI’ concerns | NPR)

【2月26日】Anthropic、公式に拒否

2月26日、Anthropicは国防総省の要求を正式に拒否すると発表した。

(参考:Anthropic rejects Pentagon demand | Washington Post)

ダリオ・アモデイは「良心に従って彼らの要求に応じることはできない」と述べた。

この判断は、ビジネス的には大きなリスクだった。2億ドルの契約を失うだけではない。米国政府との関係が悪化すれば、他の政府機関との取引にも影響する。さらにAnthropicは未上場のスタートアップで、資金調達にも悪影響が出る可能性があった。

それでもアモデイは「これは一企業の商業的判断ではなく、AI業界全体の前例を作る問題だ」という立場を崩さなかった。

なぜここまで強硬なのか。それはAnthropicの成り立ちに深く関わっている。

ダリオ・アモデイがOpenAIを辞めたのは、まさに「安全性が商業的な圧力に負ける」ことへの懸念からだった。OpenAIが利益を追求する方向に舵を切る中で、「安全性を最優先にする組織」を自分で作ろうとしたのがAnthropicだ。ここで政府の圧力に屈して安全措置を外せば、会社の存在意義そのものが崩れる。

【2月27日】ブラックリスト入り。そして皮肉な展開

2月27日金曜日。期限の日に、立て続けに3つのことが起きた。

① サプライチェーンリスク指定

ヘグセス国防長官がAnthropicを「サプライチェーン上の国家安全保障リスク」に正式指定した。これにより、米軍と取引するすべての請負業者・サプライヤー・パートナーに対して、Anthropicとの一切の商業活動が禁止された。

(参考:Pentagon moves to designate Anthropic as a supply-chain risk | TechCrunch)

この措置がどれほど異例かを理解するために、少し補足する。サプライチェーンリスク指定は、これまで米国の敵対国(主に中国やロシア)に関連する企業にしか使われたことがなかった。米国企業に対してこの指定が行われたのは、史上初めてのことだ。

② トランプ大統領の指示

同日、トランプ大統領が連邦政府全体に対してAnthropic製品の使用停止を指示した。国防総省だけでなく、すべての政府機関からAnthropicが締め出されることになった。

(参考:Trump administration orders agencies to cease business with Anthropic | CNN)

③ OpenAIが同じ日に国防総省と契約

同じ日の夜、OpenAIのサム・アルトマンCEOが国防総省との契約を発表した。Claudeの代わりにOpenAIのモデルを軍の機密システムに導入するという内容だ。

(参考:Our agreement with the Department of War | OpenAI)

ここで皮肉なことが起きた。

OpenAIの契約にも、「大量監視禁止」「自律型兵器禁止」という、Anthropicとほぼ同じ条件が含まれていた。

(参考:OpenAI’s Sam Altman announces Pentagon deal with ‘technical safeguards’ | TechCrunch)

Anthropicが「これだけは譲れない」と言って排除された、まさにその条件を、OpenAIはつけたまま契約できたことになる。

ただし、専門家はOpenAIの条件にはAnthropicのものより曖昧な部分があると指摘している。たとえば、OpenAIの契約は米国人の「公開情報」の収集を明示的に禁止していない。また、「自律型兵器」の禁止についても、技術的な制約(クラウドベースの展開ではエッジ展開が必要な完全自律型兵器の動作が不可能)に依存しており、契約上の明確な禁止ではないという見方もある。

(参考:OpenAI-Pentagon deal faces same safety concerns | Axios)

【2月28日〜】法廷闘争の宣言

Anthropicは即座に法的な反撃を宣言した。

(参考:Anthropic to take Trump’s Pentagon to court | Axios)

Anthropicの主張の根拠は、合衆国法典第10編第3252条(10 USC 3252)という法律だ。この条文によると、サプライチェーンリスク指定は国防総省との直接契約にのみ適用されるべきもので、他の顧客にサービスを提供している軍事請負業者にまで拡大するのは法律の範囲を超えているという主張だ。

つまり、「国防総省がAnthropicとの契約を打ち切るのは自由だが、軍の請負業者が自社のために使っているClaudeまで禁止するのは違法だ」ということだ。

Anthropicは声明でこう述べている。「この指定は法的に根拠がなく、政府と交渉するすべてのアメリカ企業にとって危険な前例を作るものだ」。

(参考:Statement on the Department of War | Anthropic)

連邦地方裁判所(おそらくワシントンD.C.)への提訴は数週間以内とみられている。

なぜこれが「一企業の問題」ではないのか

この一件が注目される理由は、単にAnthropicと国防総省が揉めたからではない。AI企業と政府の力関係がどうあるべきかという、根本的な問いを突きつけているからだ。

問い① 安全性の基準は誰が決めるのか

国防総省は「法律の範囲内なら使い方は軍が決める」と主張する。Anthropicは「たとえ合法でも、濫用リスクが高い用途は認められない」と主張する。

法律に違反していなければ何をやってもいいのか、それとも法律以上の倫理基準をAI企業が持つべきなのか。この問いに正解はない。でもAnthropicの排除は、「企業が独自の安全基準を主張すること自体がリスクだ」というメッセージを業界全体に送っている。

問い② 倫理を貫いた企業が排除されたら、何が起きるか

他のAI企業は今回の件を見ている。安全性を主張すればブラックリストに載る。主張しなければ契約が取れる。この構造が定着すると、AI企業が安全性について声を上げるインセンティブがなくなる。

「安全性を口にする企業ほど損をする」という市場が生まれかねない。

問い③ OpenAIが同じ条件で契約できた矛盾

Anthropicが排除された条件と、OpenAIが認められた条件がほぼ同じだという事実は、この問題が純粋に「安全措置の内容」の問題ではない可能性を示している。

政治的な思惑、企業の政権との関係性、「ウォーク」というレッテル。複数の要因が絡み合っている。

今後どうなるか

現時点で見えているシナリオは3つある。

- シナリオ①: Anthropicが裁判で勝つ。サプライチェーンリスク指定が取り消される。ただし、裁判には数年かかる可能性があり、その間のビジネスへのダメージは避けられない

- シナリオ②: 政治的な和解。水面下で交渉が進み、Anthropicが一部条件を緩和する代わりに指定が解除される。ただしアモデイの過去の発言を見る限り、レッドラインを動かす可能性は低い

- シナリオ③: 長期化。裁判が続く中でAnthropicは民間市場に集中し、政府との関係は凍結状態が続く。Anthropicの企業価値や資金調達への影響が焦点になる

いずれにしても、この件の結末はAI業界全体の方向性を左右する。

それぞれの立場から上がった声

この件は、テック業界と政界の両方で大きな反響を呼んだ。立場によって見方がまったく異なる。

国防総省・トランプ政権を支持する声

トランプ大統領はSNSでこう投稿した。「Anthropicの左翼の連中は、国防総省に強硬姿勢を取るという壊滅的な過ちを犯した」。

(参考:Pentagon’s Anthropic fight reshapes its relations with Silicon Valley | Washington Post)

ヘグセス国防長官はXで「Anthropicの姿勢はアメリカの原則と根本的に相容れない」と声明を出した。

イーロン・マスクもXで「Anthropicは西洋文明を嫌っている」と投稿し、政権側を支持した。

(参考:Anthropic Gains Tech Worker Support in Pentagon AI Dispute | Bloomberg)

Anthropicを支持する声

競合であるはずのOpenAI CEOサム・アルトマンが意外な反応を見せた。社内メモで「AIは大量監視や自律型致死兵器に使われるべきではないという考えを、私たちは長年持ってきた」と述べ、Anthropicの懸念に理解を示した。

(参考:Pentagon-Anthropic AI standoff | CNBC)

Anthropicの社内でも、技術チームのメンバーがXで公に会社への支持を表明した。AIアラインメント(安全性研究)チームのTrenton Bricken氏は「これはまさに、企業が正しいことをしている場面が目に見えるケースだ」と投稿した。

法律の専門家からも批判が上がった。トランプ政権のAI政策顧問を務めたこともあるDean Ball氏(Foundation for American Innovation上級研究員)は、サプライチェーンリスク指定について「ほぼ確実に違法であり、企業殺しの試みだ」と評した。

(参考:Experts raise questions about Pentagon’s threat to blacklist Anthropic | DefenseScoop)

上院軍事委員会の主要メンバーは、AnthropicとPentagonの双方に対して非公開書簡を送り、交渉を延長して議会と協力して解決策を見つけるよう促した。

歩道に書かれた支持のメッセージ

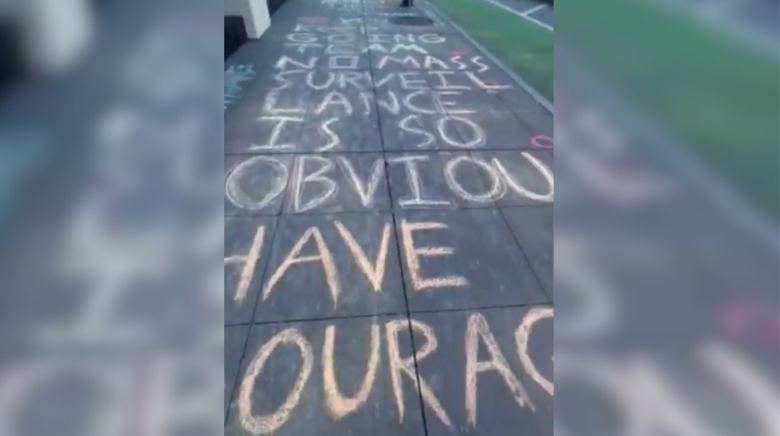

2月27日の朝、サンフランシスコのAnthropicの本社ビル(500 Howard St.)の前で、ちょっと変わった光景が広がっていた。歩道一面にチョークで応援メッセージが書かれていたのだ。

「Thank you for defending our freedoms(私たちの自由を守ってくれてありがとう)」「Have courage(勇気を持って)」「God loves Anthropic(神はAnthropicを愛している)」「No mass surveillance is so obvious(大量監視がダメなのは当たり前)」。

アメリカ国旗のイラストも描かれ、メッセージはビルの角を回って何十件も続いていた。著名VCのロイ・E・バハト氏がその様子をXに動画で投稿し、大きな反響を呼んだ。

(参考:S.F. sidewalk chalk defends AI firm Anthropic in feud with Pentagon | Mission Local)

さらに、同日夜にOpenAIがペンタゴンとの契約を発表すると、今度はOpenAIのミッションベイ本社前にもチョークメッセージが出現した。「History is watching(歴史が見ている)」「Don’t help the government spy on Americans(政府がアメリカ人を監視する手助けをするな)」。建物の周囲には赤いチョークで一周するラインが引かれた。これは「レッドライン(越えてはならない一線)」を意味していた。

(参考:Chalk Wars: It’s OpenAI vs. Anthropic on San Francisco’s sidewalks | Mission Local)

テック企業の前に応援のチョークメッセージが書かれるなんて、普通はありえない。でも今回の件がそれだけ多くの人の感情を動かしたということだ。Amazon、Google、Microsoftの社員も含む2つの連合が、自社の経営陣に対して「ペンタゴンのAI無制限使用要求に従うな」と求める署名活動を開始している。

(参考:Anthropic Gains Tech Worker Support in Pentagon AI Dispute | Bloomberg)

日本にとっての意味

「アメリカの話でしょ」と思うかもしれない。でも、これは日本のAI産業にとっても他人事ではない。

日本でもAIの政府利用は進んでいる。自衛隊のAI活用、行政のDX、治安維持へのAI導入。こうした場面で、AI企業がどこまで安全措置を主張できるのか、政府がどこまで企業に従わせるのか。アメリカで今起きていることは、そのまま日本でも起きうる構造的な問題だ。

Anthropicの選択が正しかったかどうかは、まだわからない。

でも一つだけ確かなことがある。AIの安全性について声を上げること自体が、これほどのリスクを伴う時代になったということだ。

AI LIFEコミュニティでは、AI技術の最新動向だけでなく、AIの倫理や社会的影響についても日々議論しています。

「AIの未来がどこに向かっているのか知りたい」「自分のビジネスにどう影響するのか考えたい」という方は、ぜひコミュニティにご参加ください。