AIに質問するたびに、裏側でGPUが動いている。つまり、データセンターのサーバーが稼働して電力を消費している。

そのGPUの性能とコストが、AIサービスの価格を決めている。

NvidiaがCES 2026で発表した次世代チップ「Vera Rubin」は、推論コストを前世代の10分の1にする。これが何を意味するのか整理したい。

(参考:NVIDIA Newsroom – Rubin Platform AI Supercomputer)

「AIのコスト」って、そもそも何の話なのか

まず「AIのコスト」が何を指しているのか。ここがわからないと、10分の1と言われてもピンとこない。

ChatGPTの月額20ドル(約3,000円)。あれは何に対して払っているのか。

AIに質問すると、データセンターにあるGPUが計算を始める。「こんにちは」と打てば数秒、長文の要約を頼めば数十秒。その間ずっとGPUが電力を消費し、冷却装置が動き、サーバーの場所代がかかっている。

これを「推論コスト」と呼ぶ。1回の質問あたり、GPUの計算にいくらかかるか。それがAIサービスの原価になる。

具体的には、こういうものが積み上がっている。

- GPU本体の価格:現行のNvidia H100で1基約400万円。データセンターには数千〜数万基ある

- 電気代:大規模AIデータセンターの年間電力消費は中小都市レベル

- 冷却費:GPUの発熱を冷やすための空調・液冷システム

- ネットワーク・施設費:サーバーラック、通信回線、物理的なスペース

これが全部まとめて「1トークンあたり○ドル」という推論コストになる。ChatGPTの月額料金も、ClaudeのAPIの従量課金も、この数字から逆算して決まっている。

Vera Rubinが下げるのは、この全部だ。具体的にどの部分がどう安くなるのか、順に見ていく。

Vera Rubinが安くできる理由。3つの技術革新

「10分の1」という数字の裏には、3つの技術的なブレイクスルーがある。

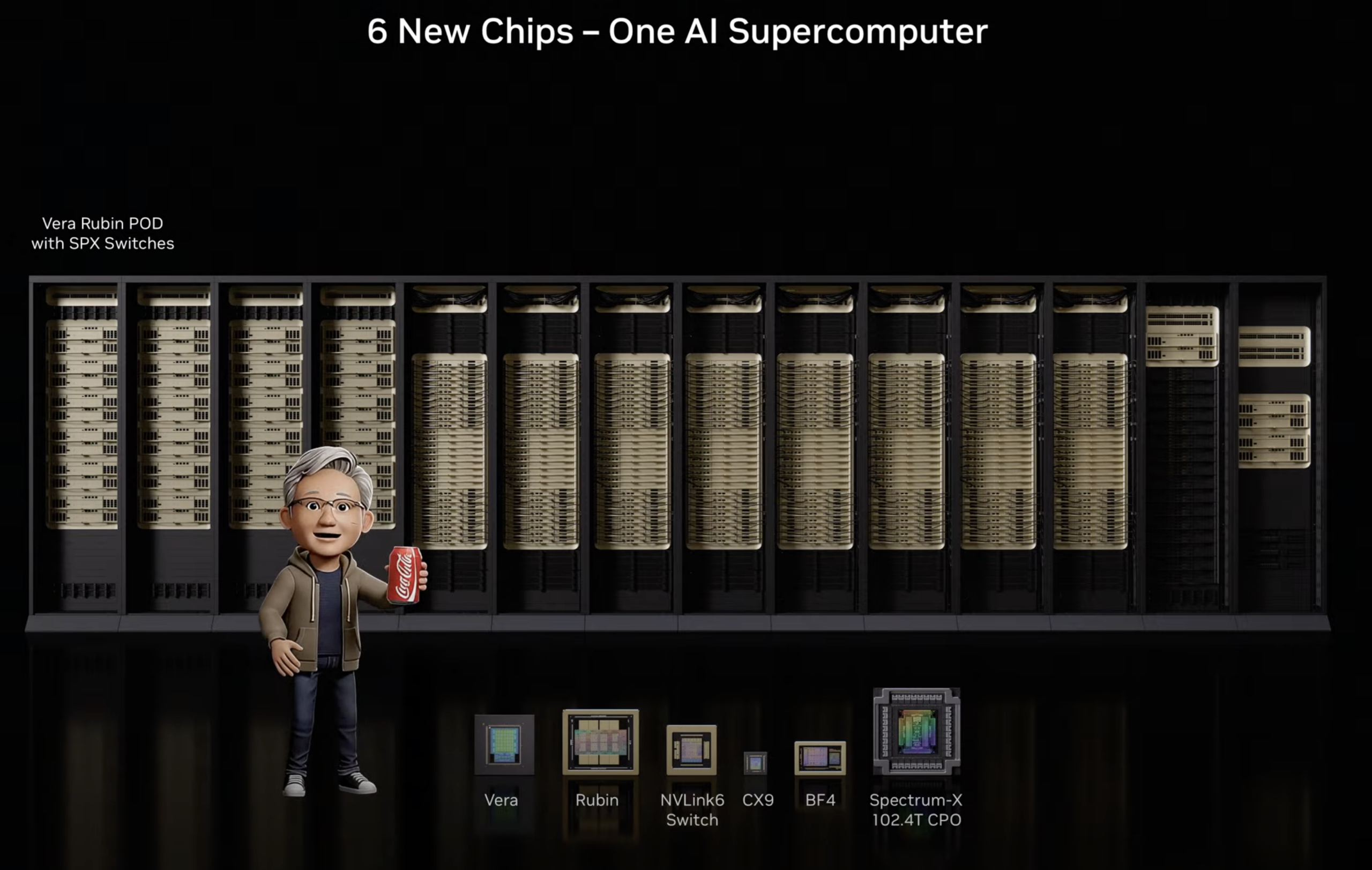

1. 6つのチップを一体で設計した

従来のAIシステムは、GPUが計算し、CPUが制御し、メモリがデータを保持する。それぞれ別のメーカーが別々に作ったチップを組み合わせていた。

Vera Rubinは、6つのチップを最初から一体で設計した。

- Rubin GPU:3,360億トランジスタの演算チップ

- Vera CPU:88コアの制御用プロセッサ

- NVLink 6 Switch:GPU同士を超高速で繋ぐ通信チップ

- ConnectX-9 SuperNIC:外部ネットワーク接続

- BlueField-4 DPU:データ処理とセキュリティ専用

- Spectrum-6 Ethernet Switch:大規模ネットワーク用

GPUだけ速くしても、CPUとの通信やメモリの読み書きで詰まれば意味がない。6つを一体で最適化することで、チップ間のムダな待ち時間がなくなった。

これによって下がるコストは、「必要なGPU台数」と「施設費」だ。

同じ処理に必要なサーバーの数が減るので、ラックの場所代、冷却装置、管理コストが全部連動して下がる。

2. HBM4メモリで「データの渋滞」を解消

AIの推論で一番のボトルネックは、実はGPUの計算速度ではない。メモリからデータを読み出す速度だ。

GPUがいくら速く計算できても、必要なデータがメモリから届かなければ待つしかない。高速道路が8車線あっても、料金所が1つしかなければ渋滞する。それと同じことがチップの中で起きている。

Vera RubinのHBM4メモリは帯域幅22TB/s。前世代の約2.8倍。

料金所が3倍近くに増えたようなもの。GPUが待つ時間が大幅に減り、同じ時間でより多くの推論処理ができるようになった。

これによって下がるコストは「電気代」と「GPUの計算時間」だ。

GPUが「データ待ち」で空回りしている時間が減る。同じ電力で2.8倍のデータを処理できるので、1回の推論あたりの電力消費が大きく下がる。

3. NVLink 6でGPU間の通信速度が2倍に

ChatGPTやClaudeのような大規模AIモデルは、1つのGPUには収まらない。数十〜数百のGPUに分散して処理する。

このとき、GPU同士がデータをやり取りする速度が重要になる。前世代のBlackwellではGPU間の通信帯域は1.8TB/s、NVL72ラック1台の推論性能は約720PFLOPSだった。

Vera RubinのNVLink 6は、これを通信帯域2倍の3.6TB/sに引き上げた。72基のGPUをまとめた「NVL72」ラック1台で、推論性能3.6EFLOPS(エクサフロップス)。前世代の5倍。Jensen Huang曰く「インターネット全体より広い帯域幅」。

(参考:NVIDIA Blog – CES 2026 Special Presentation)

これによって下がるコストは「電気代」と「GPU本体の価格」。GPT-4やClaudeのような巨大モデルは数百基のGPUに分散して処理する。GPU間の通信が2倍速くなれば、処理中にGPUが「隣のGPUのデータ待ち」で電力を空回りさせる時間が減る。同じ処理に必要なGPU台数も減るので、GPU購入費も連動して下がる。

Blackwellと比べて、数字で見る

| 項目 | Blackwell(現世代) | Vera Rubin(次世代) | 改善 |

|---|---|---|---|

| 推論性能 | ~720 PFLOPS | 3,600 PFLOPS | 5倍(つまり同じ時間で5倍の量を処理できる) |

| 推論コスト(1トークンあたり) | ベースライン | 1/10 | 10倍安い(つまり同じ質問を1/10の電気代で処理できる) |

| MoEトレーニング必要GPU | ベースライン | 1/4 | 4倍少ない(つまりAIの学習に必要なGPU購入費が1/4に) |

| GPUトランジスタ数 | 2,080億 | 3,360億 | 1.6倍(つまりチップ1個あたりの計算力が6割増し) |

| HBMメモリ帯域 | ~8 TB/s | 22 TB/s | 2.8倍(つまりデータの読み出し待ちが約1/3に短縮) |

| NVLink帯域(GPU間) | 1.8 TB/s | 3.6 TB/s | 2倍(つまりGPU同士の連携速度が倍に) |

推論性能5倍、コスト10分の1。同じお金で、これまでの10倍の計算ができるようになる。

コストが下がると、何が変わるか

ここが一番大事な話。推論コスト10分の1が、実際に何を変えるのか。

AIサービスの料金が下がる

ChatGPTの月額20ドル、Claude Proの月額20ドル。これらの価格は推論コストをベースに設定されている。

コストが10分の1になれば、同じ料金で10倍使えるようになるか、料金そのものが下がるか、あるいはその両方が起きる。

実際、Jensen Huangは「AIトークンのコストは毎年10倍ずつ下がっている」と言っている。ChatGPTが登場した2022年から比べると、すでに推論コストは100分の1以下。その流れがさらに加速する。

AIエージェントが「24時間稼働」できるようになる

今のAIは「質問したら答える」が基本。でもAIエージェント(自律的にタスクをこなすAI)は、常に動き続ける必要がある。

問題はコストだった。AIエージェントを24時間動かすと、推論コストが月に数十万円になることもある。中小企業には現実的ではない。

10分の1になれば、月数万円レベルで24時間AIエージェントを動かせる。メール対応、データ分析、カスタマーサポート。人を雇うよりはるかに安い。

動画・音声・画像のAI生成が身近になる

テキスト生成より、画像や動画の生成は何十倍もGPUを使う。SoraやRunway、MidJourneyのようなサービスが高額なのはそのためだ。

推論コストが下がれば、動画生成のAPI料金も下がる。今は1分の動画生成に数百円かかるものが、数十円になる可能性がある。

中小企業が「自社専用AI」を持てるようになる

自社データで学習させた独自AIモデル。大企業しか手が出なかったが、トレーニングに必要なGPU数が4分の1になれば話が変わる。

自社の顧客データを学習したAIチャットボット、社内ナレッジを理解したAIアシスタント。「作れるけどコスト的に無理」が「現実的」に変わる。

2026年後半からクラウドで使える

Vera Rubinはすでに量産中。2026年後半から主要クラウドで利用可能になる。

- AWS、Google Cloud、Microsoft Azure、Oracle Cloud

- CoreWeave、Lambda、Nebius(AI特化クラウド)

自前でハードウェアを買う必要はない。クラウド経由で使える。

もっと言えば、ChatGPTやClaudeの裏側のインフラが更新されれば、ユーザーは何もしなくても恩恵を受けられる。APIを使っている企業は、同じ使い方のままコストが下がる。それが一番シンプルで大きいインパクトだ。

AIが「みんなのもの」になる転換点

2026年3月16日からサンノゼで開催されるGTC 2026で、Vera Rubinのさらなる詳細が発表される。さらに次世代の「Feynman」アーキテクチャ(TSMC 1.6nmプロセス)も控えている。

コストが下がれば、使える企業が増える。使える企業が増えれば、AIの実用化が加速する。Vera Rubinは、AIを「一部の大企業のもの」から「みんなのもの」に変えるチップだ。

AI LIFEコミュニティでは、こうしたAIインフラの進化がビジネスにどう影響するかを日々議論しています。

AI LIFEコミュニティに参加する